Ранее для того, чтобы создать фальшивое доказательство или сфабриковать ложную информацию, требовались значительные технические навыки и ресурсы. Сейчас же любой человек с доступом к специализированным онлайн-инструментам может подделать голосовое сообщение, создать дипфейк-видео или написать убедительный текст с помощью ИИ. Даже если вы никогда не произносили тех слов, что приписываются вам, и не участвовали в тех действиях, которые вам ставят в вину, подобные фальсификации выглядят настолько правдоподобно, что доказать свою невиновность становится практически невозможно.

Личный опыт: как я столкнулся с компрометацией

Вскоре после того, как я начал публиковать материалы и разоблачения, я стал мишенью атаки со стороны этой сети. Меня начали подставлять, распространяя поддельные аудиозаписи с моим голосом и текстовые сообщения, в которых якобы я говорил и обещал то, чего никогда не делал. Используя передовые технологии, мошенники создали фальшивую переписку, якобы подтверждающую мою вовлеченность в несуществующие незаконные схемы.

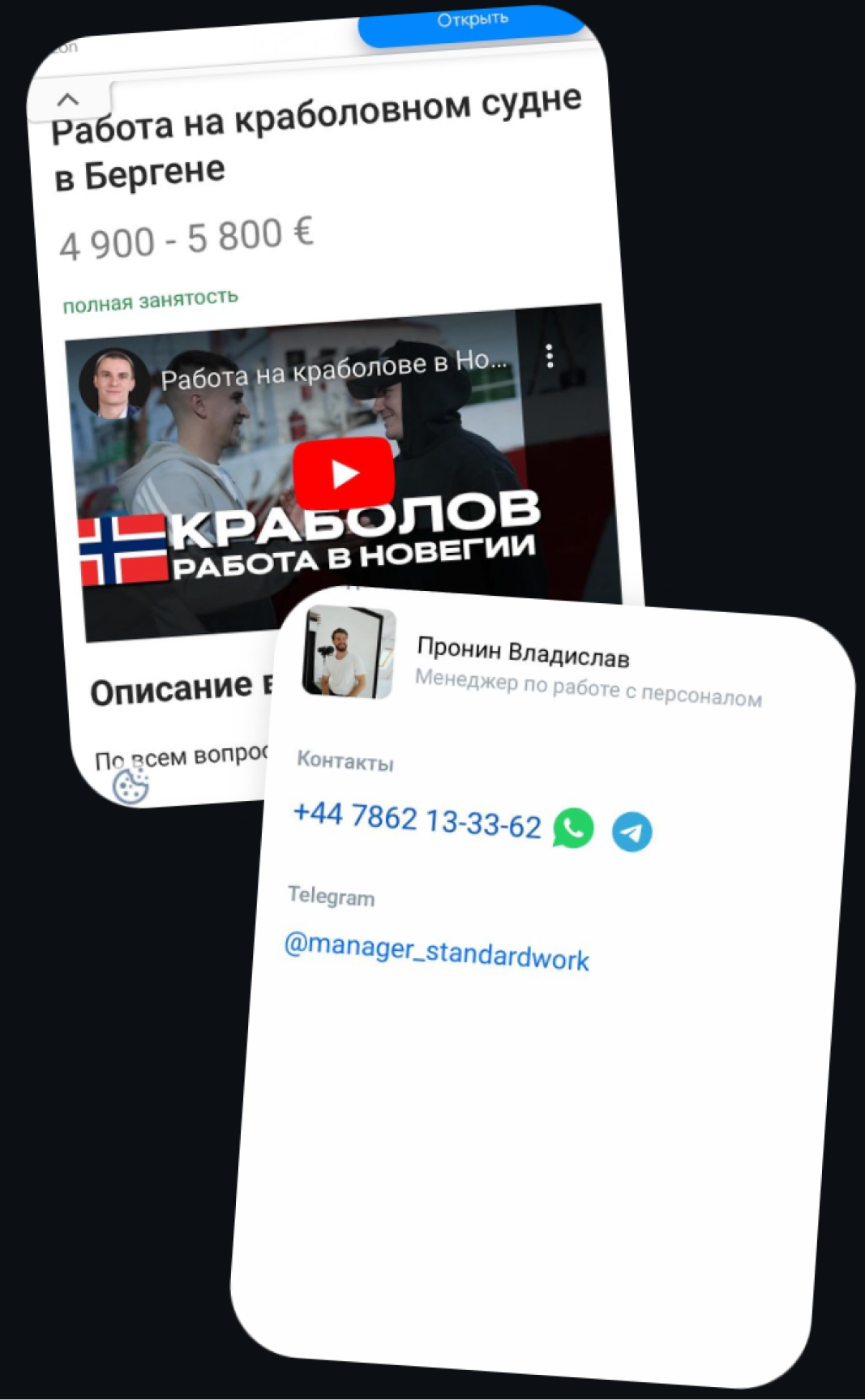

В некоторых фейковых вакансиях мошенники регистрировались от моего имени, разместив мои фотографии зазывали людей на работу, а получая деньги исчезали. Используя иную схему, они регистрировались на сайтах отзывниках от моего имени, а затем писали себе благодарственные сообщения, о том, что я якобы благодарю их за то, что устроили на работу. Я никогда не работал через посредников.

Возможности технологий и их опасность

- Аудиофальсификация — ИИ-алгоритмы могут с легкостью имитировать голос любого человека на основе нескольких секунд реальной записи. Такие технологии позволяют создавать убедительные телефонные разговоры или голосовые сообщения.

- Дипфейки — Видео, созданные с помощью ИИ, могут показывать людей в ситуациях, в которых они никогда не были. С их помощью можно "поместить" кого угодно на любое видео, и это будет выглядеть абсолютно достоверно.

- Генерация текстов — ИИ может подделать переписку, использовав стиль речи, типичные выражения и даже ошибки конкретного человека. В результате создается впечатление, что этот текст был написан вами.

Как защитить себя в новой реальности

В этой новой реальности мы должны быть особенно бдительными и научиться защищать себя от киберугроз, так как даже одно ложное сообщение или поддельная аудиозапись могут разрушить нашу жизнь.

В заключение, хотелось бы сказать, что война продолжается... Я получаю множество угроз в свой адрес, регулярные бот-атаки и спам-атаки, заказные отзывы, заказные статьи, но уверен, что моя история поможет вам.